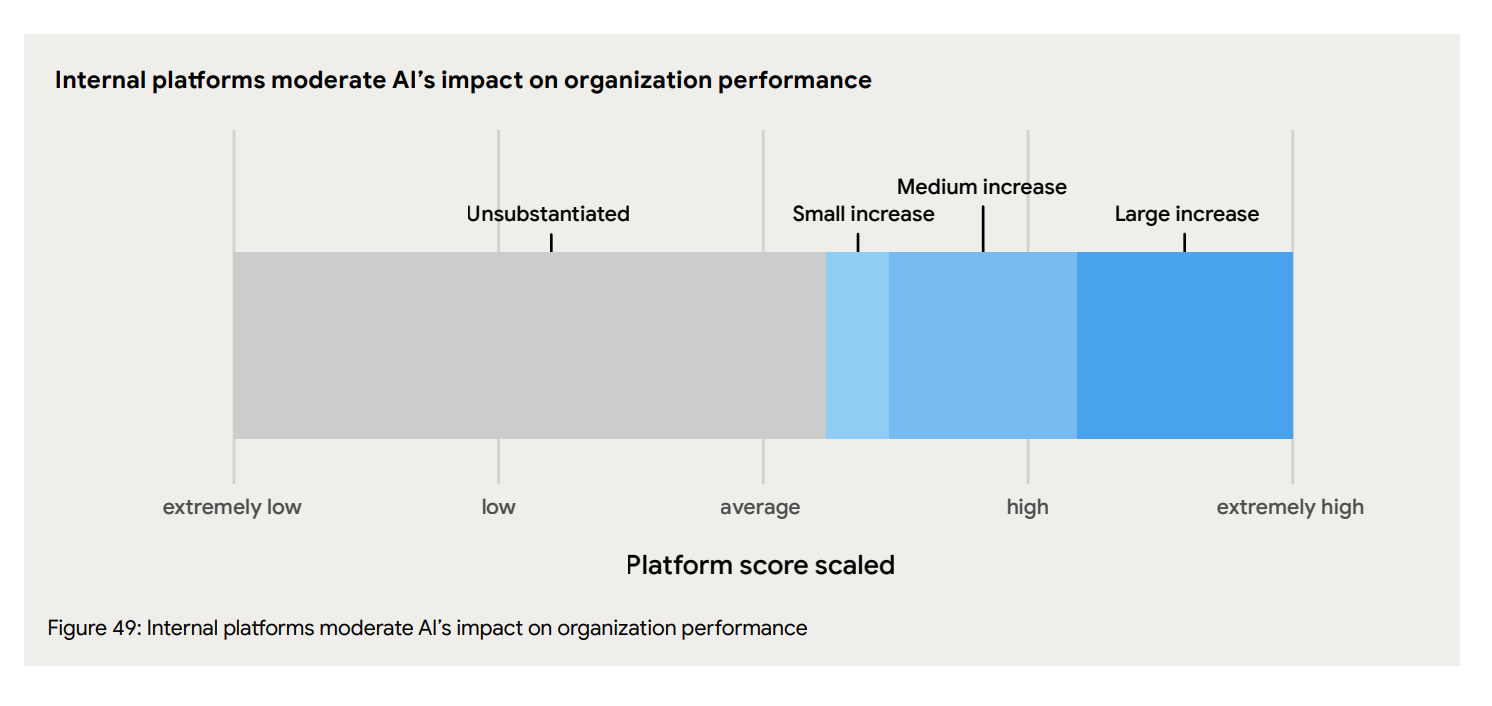

Inwestycje AI bez idącej w parze inwestycji w wysokiej jakości platformy prawdopodobnie nie przyniosą znaczących zwrotów na poziomie całej organizacji.

Źródło: DORA report 2025

Źródło: DORA report 2025

Tworzy to wyraźną linię podziału pomiędzy firmami, które dają pracownikom dostęp do modeli AI, a tymi, które budują infrastrukturę pozwalającą z nich faktycznie korzystać.

Wdrażając AI w Lisku przyjęliśmy tę drugą ścieżkę. Zbudowaliśmy wewnętrzną platformę, która łączy wszystkie funkcje - marketing, commercial, operacje, finanse, HR - z naszymi produkcyjnymi systemami. Infrastrukturę organizacyjną, która zmienia sposób przepływu informacji, podejmowania decyzji i uczenia się firmy.

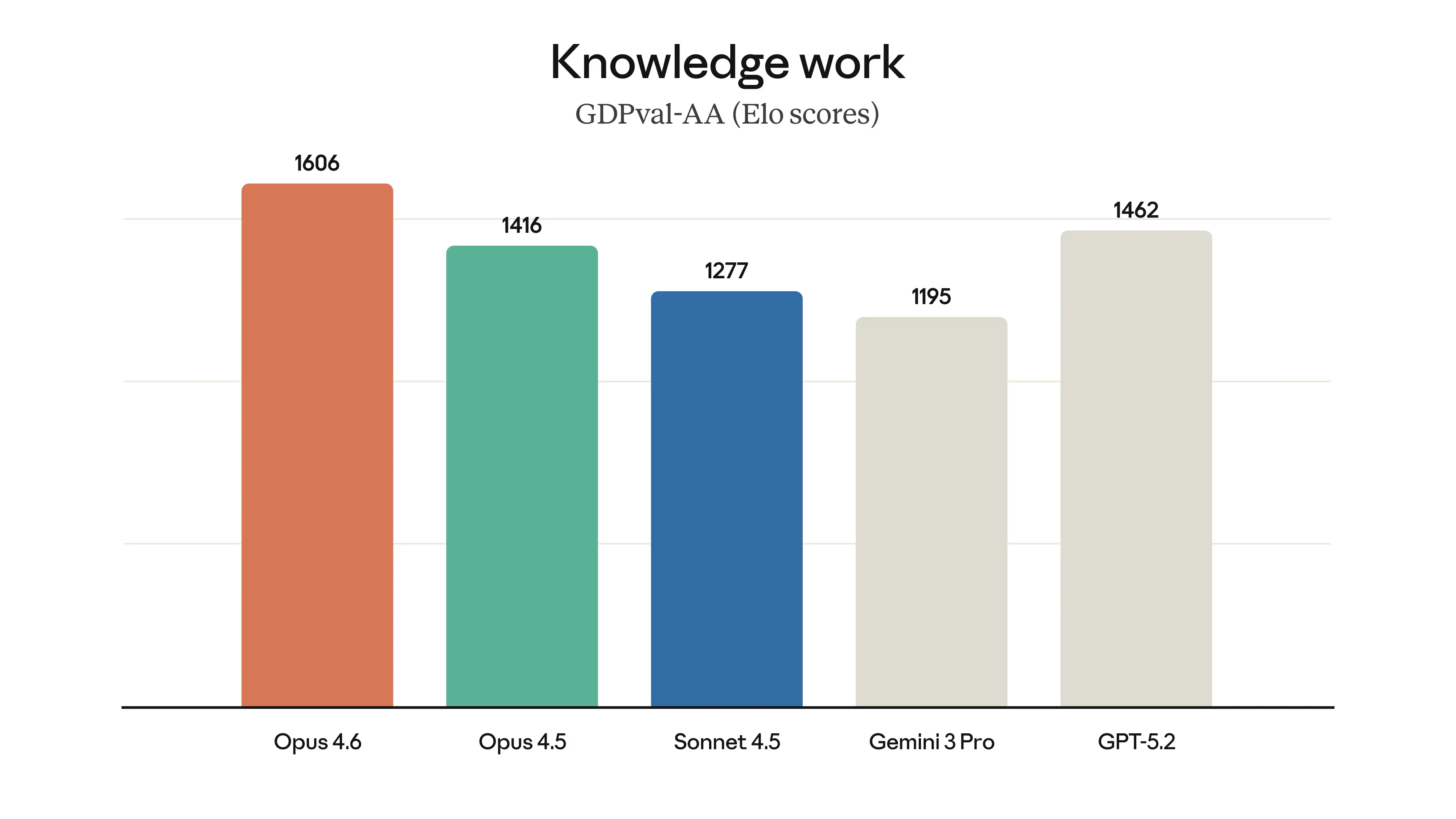

Całą platformę oparliśmy o Claude Code działający z poziomu terminala. Udostępnienie narzędzia terminalowego pracownikom nietechnicznym było dużym wyzwaniem, ale korzyści - interakcja z AI w kontekście lokalnych plików, narzędzi i naszych systemów informatycznych - znacznie to przewyższają. Sam Claude Code (oparty na modelu Opus 4.6) jest na podium rankingów pracy biurowej.

Dostęp do zasobów wewnętrznych zapewnia utrzymywany przez nas serwer MCP (Model Context Protocol) - otwarty protokół, który standaryzuje sposób łączenia modeli AI z zewnętrznymi źródłami danych. W naszym przypadku najważniejszy był dostęp do danych operacyjnych w czasie rzeczywistym - z uprawnieniami ograniczonymi do odczytu.

Kluczowym elementem całego systemu jest wspólny kontekst organizacyjny utrzymywany we współdzielonym pliku CLAUDE.md. Plik ten zawiera kontekst biznesowy, który definiuje jak AI rozumie naszą firmę. Zawiera definicję podstawowych KPI, mapuje nasze darkstory, opisuje podstawowe statusy zamówień. Kontekst ten jest wersjonowany i dystrybuowany automatycznie przez skrypty instalacyjne.

Co istotne, CLAUDE.md ewoluuje z każdym tygodniem użytkowania. Kiedy użytkownik odkryje, że AI źle interpretuje metrykę lub nie zna reguły biznesowej, kontekst jest aktualizowany i od tego momentu każda przyszła interakcja, dla każdego użytkownika, jest lepsza.

Najtrudniejsza część nie miała nic wspólnego z AI. Była to dystrybucja samej platformy - dotarcie z działającym narzędziem na laptopy naszych pracowników z różnymi systemami operacyjnymi i konfiguracjami. Postawiliśmy na jednokomendową instalację - osobne skrypty dla Windows (PowerShell) i macOS (bash), które automatycznie instalują Claude Code, konfigurują połączenie z naszym serwerem MCP, pobierają kontekst firmowy i instalują nasze skille.

Najbardziej zaskoczyło nas to, co stało się po wdrożeniu - rzeczy, których nie zaprojektowaliśmy. Analitycy zaczęli budować interaktywne dashboardy w ciągu kilku minut. Managerowie odpowiedzialni za nasze operacje zaczęli tworzyć automatyzację, nie zdając sobie sprawy, że programują. Eksperci domenowi znajdowali niespójności w danych, które łatwo było przegapić inżynierom. Ludzie z różnych działów niezależnie odpytywali te same dane z różnych perspektyw i odkrywali wzorce, których żaden pojedynczy zespół by nie zobaczył.

Dodaliśmy możliwość automatycznego publikowania tych analiz w naszej wewnętrznej sieci. To zmieniło dynamikę platformy fundamentalnie - w dwóch wymiarach jednocześnie.

Po pierwsze, wiedza, która wcześniej zostawała w prywatnych rozmowach z AI, zaczęła krążyć po organizacji.

Po drugie, każdy udostępniony raport okazał się najskuteczniejszą formą onboardingu - ludzie widzieli konkretne wyniki, rozumieli co platforma potrafi i sami chcieli spróbować.

Jesteśmy na początku tej drogi, ale jedno widzimy już wyraźnie - platforma AI to nie narzędzie produktywności. To infrastruktura, która zmienia sposób uczenia się organizacji. Każdy tydzień użytkowania wzbogaca kontekst, poszerza grono użytkowników i podnosi jakość odpowiedzi. Ta pętla się nakręca - i to ona, nie sam model AI, decyduje o długoterminowej wartości platformy.

Firmy, które zbudują tę warstwę wcześniej, zaczną budować przewagę, której nie da się kupić ani skopiować.